Sensitivity

- 의학적 진단 기준 : 질병이 있는 사람을 얼마나 잘 찾아내는가, 질병이 있는 사람을 질병으로 진단하는 비율

- 생체인식 기준 : Authentic을 authentic으로 잘 구분한 경우

- True Positive Rate

- 양성을 양성으로 판단

Specificity

- 정상을 얼마나 잘 찾아 내는가, 정상을 정상이라고 진단하는 비율(의학적 진단 기준)

- 생체인식 기준: Impostor을 imposter으로 잘 구분한 경우

- True Negative Rate

- 음성을 음성으로 판단

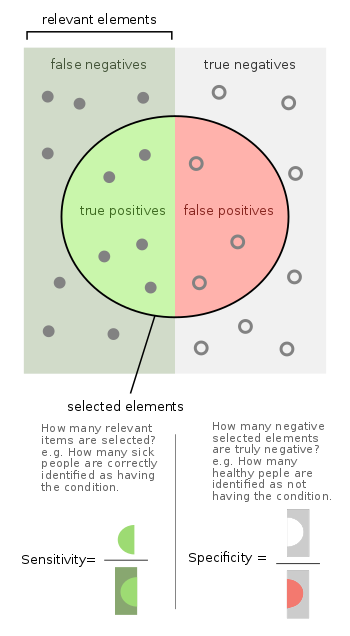

Relevant elements는 말그대로 유사한 elements, 양성인 elements와 음성인 elements를 표현한 것이다.

동그라미 구간 : positive으로 인식되는 영역

나머지 구간 : negative로 인식되는 영역

앞의 True와 False를 잘 구분되었냐, 잘 구분하지 못하였냐로 본다면 이해하기 쉽다.

True Positive: Positive element로 분류되었는데 실제로도 positive인 경우

True Negative: Negative element로 분류되었는데 실제로도 negative인 경우

False case는 한 번만 더 생각해보면 된다.

일단 의미만 봐보자

False Positive

잘못 positive로 들어왔다 →

positive가 아닌데 positive로 분류 되었다 →

얘는 negative다 →

즉 negative element가 positive element로 잘못 분류된 것이다.

False Negative

잘못 negative로 들어왔다 →

negative가 아닌데 negative로 분류 되었다 →

얘는 positive다 →

즉 positive element가 negative element로 잘못 분류된 것이다.

정리하자면

False Positive: Positive element로 분류되었는데 실제로는 negative인 경우

False Negative: Negative element로 분류되었는데 실제로는 positive인 경우

이제 위의 그림이 이해될 것이다.

Sensitivity, 민감도는 모든 positive element 중 진짜 positive element를 계산하는 것이기 때문에 계산식으로 나타내자면

Sensitivity = TP / (TP + FN)

Specificity, 특이도는 모든 negative element 중 진짜 negative element를 계산하는 것이기 때문에 계산식으로 나타내자면

Specificity = TN / (TN + FP)

으로 표현할 수 있다.

참고 1 : https://en.wikipedia.org/wiki/Sensitivity_and_specificity

'딥러닝관련 > 기초 이론' 카테고리의 다른 글

| Orthogonal (직교) vector (0) | 2021.02.07 |

|---|---|

| Norm (0) | 2021.02.06 |

| Representation (0) | 2020.07.07 |

| Batch Normalization (0) | 2020.07.06 |

| 왜 딥러닝(deep learning) 이라고 하는가 (0) | 2020.07.01 |